Scraper-Bots mit generativer KI greifen Websites 24 Stunden am Tag mit bis zu einer halben Million Informationsanfragen an. Das zeigen die aktuellen Erkennungsdaten von Barracuda. Die Threat-Analysten von Barracuda haben im Rahmen eines neuen Reports das hartnäckige Verhalten von Bots mit generativer KI (Gen AI) hervorgehoben, die Teil einer neueren Kategorie von Bots sind, die Barracuda als „Gray Bots“ bezeichnet. Dabei handelt es sich um automatisierte Programme, die nicht offensichtlich schädlich sind, aber das Internet mit dem Ziel durchsuchen, Informationen von Websites und anderen Web-Anwendungen zu extrahieren.

Die Erkennungsdaten von Barracuda zeigen:

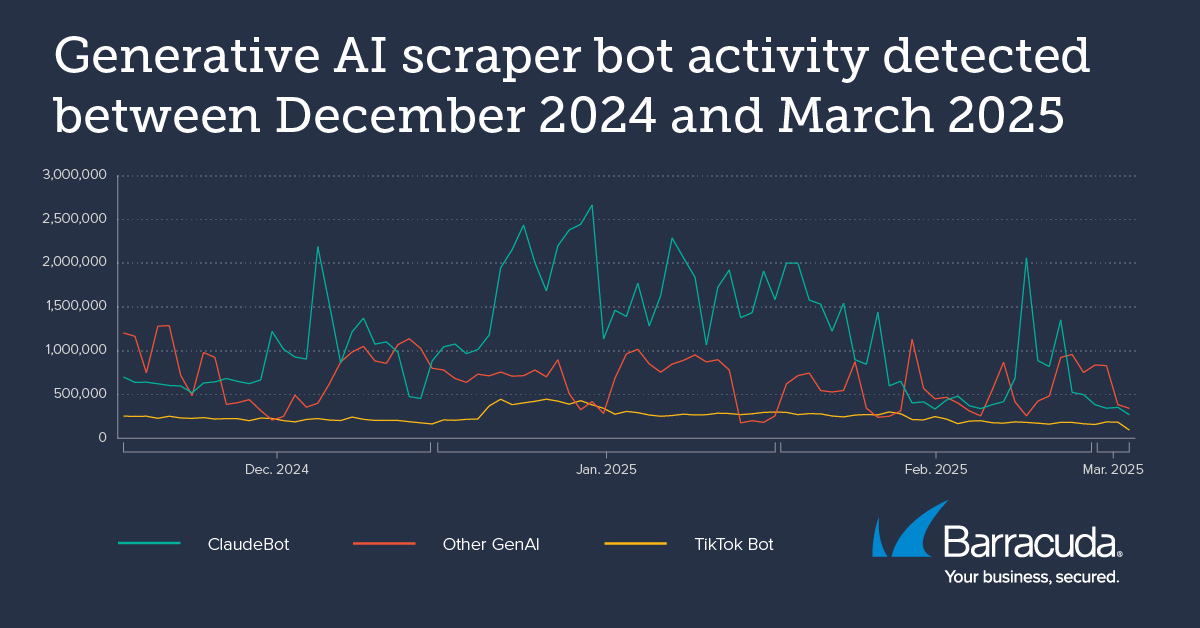

- Zwischen Dezember 2024 und Ende Februar 2025 gingen Millionen von Anfragen von Bots mit generativer KI wie ClaudeBot oder der Bytespider-Bot von TikTok bei Web-Anwendungen ein.

- Eine überwachte Web-Anwendung erhielt über einen Zeitraum von 30 Tagen 9,7 Millionen Anfragen von Scraper-Bots mit generativer KI.

- Eine weitere überwachte Web-Anwendung erhielt an einem einzigen Tag über eine halbe Million Anfragen von Scraper-Bots mit generativer KI.

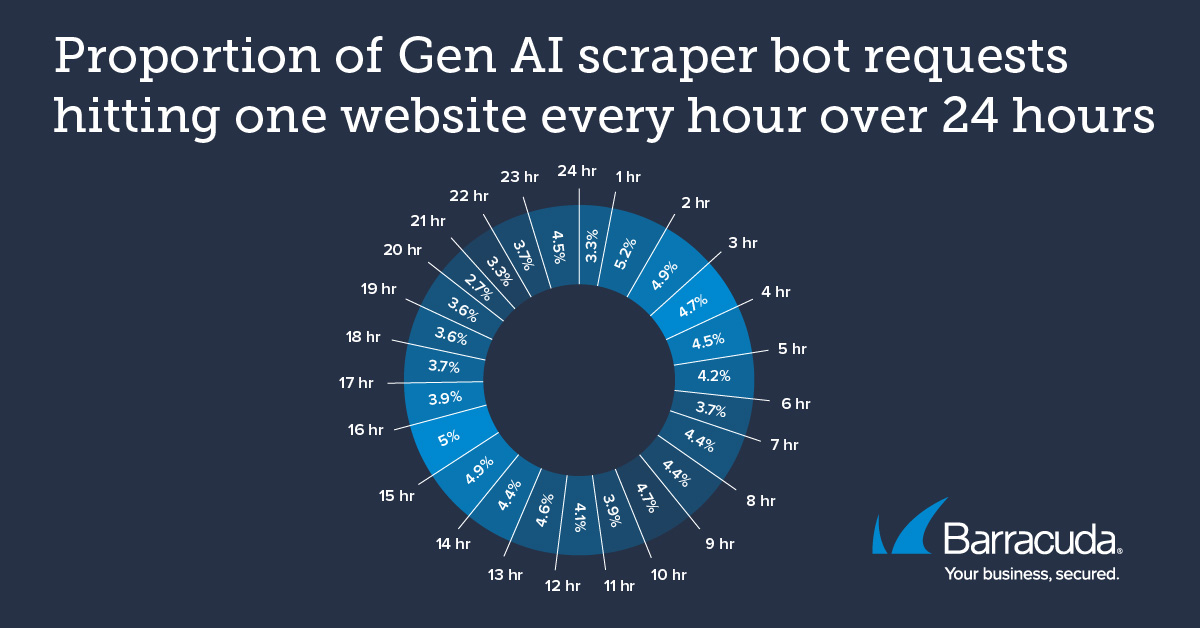

- Eine Analyse des Gray-Bot-Traffics, der auf eine weitere überwachte Web-Anwendung abzielte, ergab, dass die Anfragen – im Durchschnitt etwa 17.000 pro Stunde – über einen Zeitraum von 24 Stunden relativ konstant blieben.

„Gray Bots mit generativer KI verwischen die Grenzen legitimer Online-Aktivitäten“, sagt Rahul Gupta, Senior Principal Software Engineer, Application Security Engineering bei Barracuda. „Sie sind in der Lage, riesige Mengen sensibler, geschützter oder kommerzieller Daten abzugreifen sowie den Datenverkehr von Web-Anwendungen zu überlasten und Betriebsabläufe zu stören. Häufiges Scraping durch Gray Bots kann die Web-Performance beeinträchtigen und ihre Präsenz auf Websites kann Website-Analysen verzerren, was zu irreführenden Erkenntnissen führt und die Entscheidungsfindung beeinträchtigt. Für viele Organisationen ist die Verwaltung von Gray-Bot-Traffic zu einem wichtigen Teil ihrer Strategien zur Anwendungssicherheit geworden.“

Um sich gegen Gray Bots mit generativer KI und das Auslesen von Informationen zu schützen, können Websites die Datei robots.txt nutzen. Dabei handelt es sich um eine Code-Zeile, die der Website hinzugefügt wird und einem Scraper signalisiert, dass er keine Daten aus der Website extrahieren darf. Die Datei robots.txt ist jedoch nicht rechtsverbindlich, der spezifische Name des Scraper-Bots muss ihr hinzugefügt werden und nicht jeder Nutzer eines Bots mit generativer KI hält sich an diese Vorgabe.

Organisationen können ihren Schutz vor unerwünschten Gray Bots mit generativer KI verbessern, indem sie einen Bot-Schutz implementieren, der in der Lage ist, die Aktivitäten von Scraper-Bots mit generativer KI zu erkennen und zu blockieren. Fortschrittliche, moderne KI- und Machine-Learning-Funktionen unterstützen dabei, die schnell wachsende Bedrohungen durch Gray Bots mithilfe von verhaltensbasierter Erkennung, adaptivem Machine Learning, umfassendem Fingerprinting und Echtzeit-Blockierung unter Kontrolle zu halten.

Weitere Beispiele für Gray Bots sind Web-Scraper-Bots und automatisierte Content-Aggregatoren, die Web-Inhalte wie Nachrichten, Rezensionen, Reiseangebote und weitere Informationen sammeln.

Mehr Informationen finden Sie hier auf dem Barracuda-Blog.